Que l’intelligence artificielle ait apporté un changement majeur dans différentes couches de notre société est difficilement contestable en 2024.

Sam Altman et OpenAI ont démontré que leur technologie, exprimée par exemple sous la forme de chatbots tels que ChatGPT, est capable de changer radicalement le flux de travail dans certaines entreprises. Toutefois, la volonté d’innovation peut parfois comporter des risques qu’il convient de prendre en compte et de gérer.

L’épée à double tranchant d’OpenAI

L’année dernière, le PDG d’OpenAI s’est rendu au Congrès américain pour souligner la valeur de sa technologie, mais aussi pour inviter les régulateurs à enfiler leur bleu de travail et à définir les lois nécessaires pour contrôler les progrès de l’IA. Dans des propos rapportés par CNN, Sam Altman s’est dit convaincu que «l’intervention réglementaire du gouvernement sera essentielle pour atténuer les risques liés à des modèles de plus en plus puissants».

Quelques semaines plus tard, Sam Altman a rencontré des acteurs importants du secteur de l’intelligence artificielle, tels que Demis Hassabis, PDG de Google DeepMind, et Kevin Scott, directeur technique de Microsoft. Son objectif était, aussi grandiloquent que cela puisse paraître, d’atténuer le risque d’extinction par l’IA, en le comparant à des événements quasi apocalyptiques tels qu’une pandémie mondiale ou une attaque nucléaire.

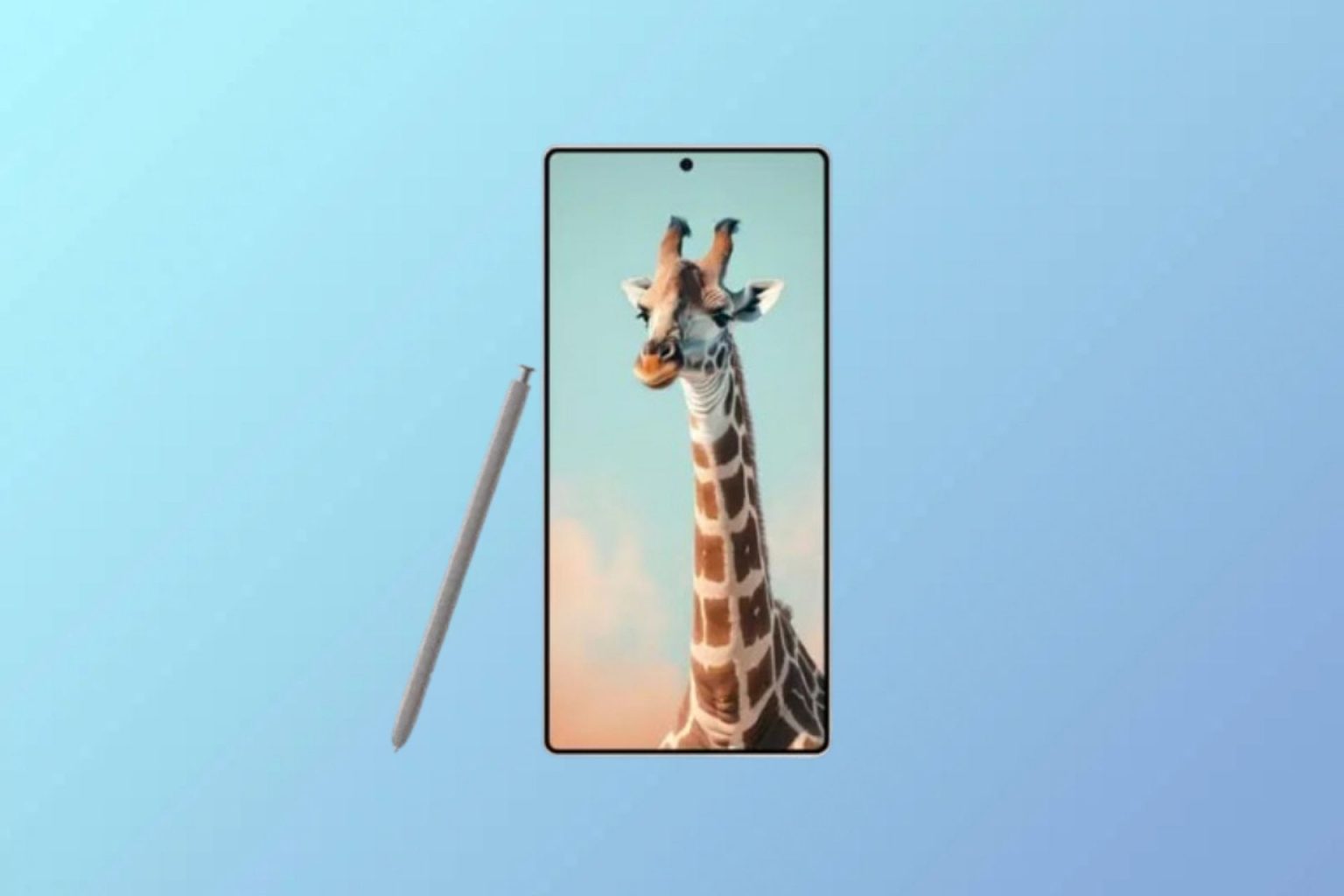

Cependant, les grandes entreprises technologiques, loin de faire une pause dans le développement de leurs innovations, sont de plus en plus conscientes qu’elles doivent repousser les limites de leurs innovations. Par exemple, il y a quelque temps, le New York Times a publié un article sur des cadres de la Silicon Valley qui unissaient leurs forces pour créer un dispositif d’intelligence artificielle.

Outre Jony Ive, l’ancien designer en chef d’Apple, Sam Altman est également à l’origine de son développement. Et oui, nous parlons d’un produit capable de remplacer nos téléphones portables et qui a la capacité d’observer, de traiter et d’analyser le monde qui nous entoure pour nous offrir des informations et des possibilités d’une manière presque magique.

Tout le monde ne partage pas la crainte du développement exagéré que notre société voit à travers les yeux de l’IA. Par exemple, Rowan Curran, analyste de la société Forrester, a assuré à CNN que :

«L’idée d’une “apocalypse de l’IA” en tant que scénario réaliste présentant un quelconque danger pour l’humanité, en particulier à court et à moyen terme, n’est qu’une spéculation technomythologique. L’accent mis sur cette idée comme l’un des grands risques liés aux progrès de l’IA détourne l’attention des véritables défis auxquels nous sommes confrontés aujourd’hui pour réduire les dommages actuels et futurs causés par les données et les modèles appliqués injustement par des acteurs humains».